這一新型的AI被稱為“生成式人工智能”(Generative AI),也就是說,機器并非如之前那樣僅分析已有的數據,而是生成了全新的東西。

——《生成式AI:充滿創造力的新世界》

我們正在進行的工作和生活,都在因為生成式AI的發展而變化,尤其是在創意這個領域。營銷行業,是創意的聚集地,也正是生成式AI“大顯身手”的地方。無論是文本內容、圖像視覺,還是視頻創意,生成式AI正在營銷工作的方方面面幫助我們尋找“新玩兒法”。

這其中,最吸引眼球的領域莫過于圖像與視覺創意的領域。紅杉資本預計,2025年,生成式AI已經可以給我們提供最終版本的產品和建筑設計圖了。這一切似乎發生的如此迅速,讓我們有些“猝不及防”。但其實早在2012年,一切就已經開始了。我們認為,這背后的驅動里就是技術模型的不斷迭代。

今天,我們就來梳理一下生成式AI在視覺領域一路走來的發展和應用吧。

背后的驅動力:算法模型發展

縱觀整個生成式AI的發展,可以說,深度學習技術的升級迭代、算法模型的發展,為計算機視覺發展奠定基礎。每一次算法模型的迭代,都會帶來一波計算機視覺領域的大發展,按照時間線,我們來了解下那些耳熟能詳的模型如何影響視覺領域發展。

01 旗開得勝:卷積神經網絡CNN

算法介紹

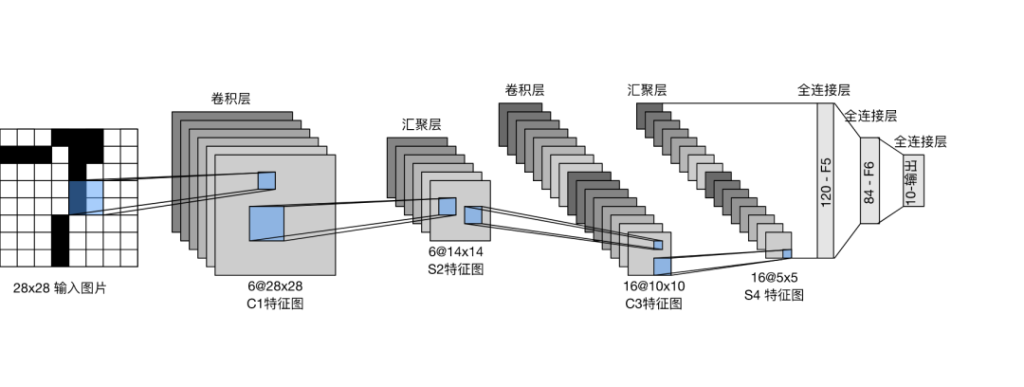

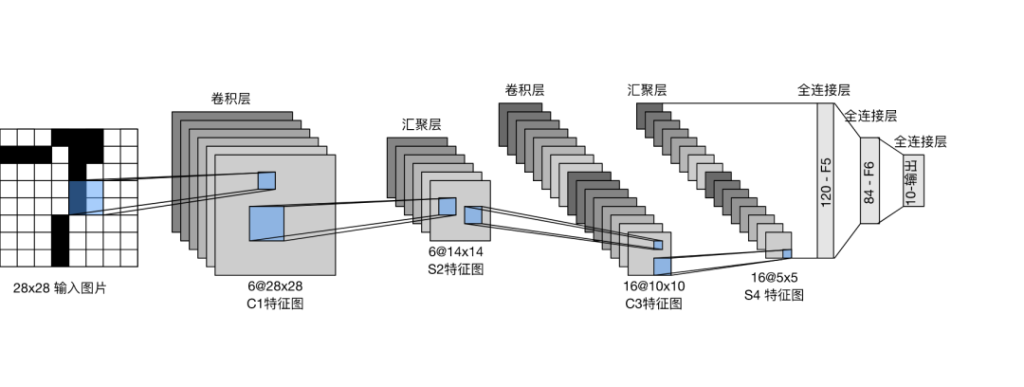

卷積神經網絡CNN的出現,是計算機視覺的一個分水嶺。在2012年之前,計算機視覺還是基于“手工算子”的傳統視覺時期。而卷積神經網絡,也就是CNN的出現,在圖像分類任務上遠超傳統算法,可謂一戰成名,開啟了深度學習的一個時代。

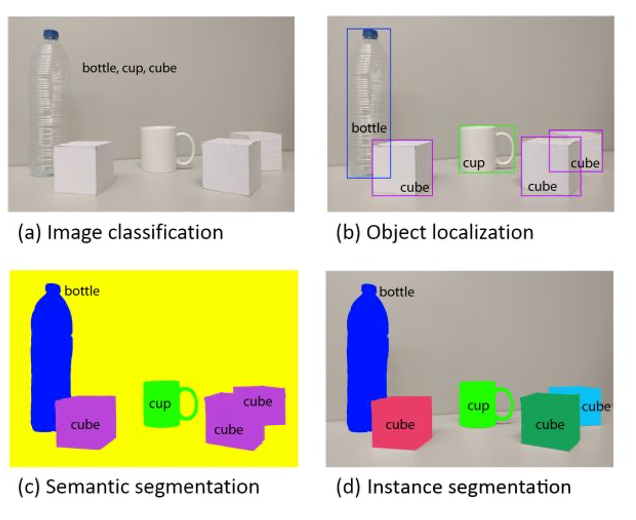

作為一種深度學習模型,CNN廣泛應用于如圖像分類、目標檢測、語義分割等視覺任務。它一般由多個卷積層、池化層或全局平均層等組成。卷積層可以自動提取輸入圖像中的特征,而池化層則可以將卷積層中的特征進行簡化和壓縮,以便更好地進行后續處理。最后,全局平均層將前面所有層的結果進行加權并進行投票,以確定輸出。在深度學習的發展中,研究者們還提出更多適用于不同任務的網絡層,從而組成復雜且龐大的網絡結構,助力神經網絡的蓬勃發展。

算法應用

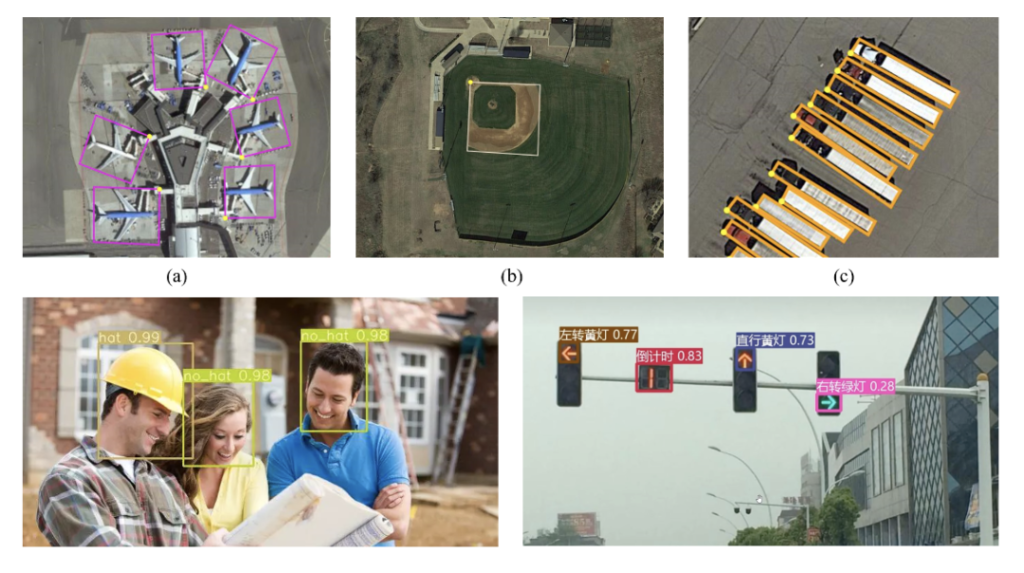

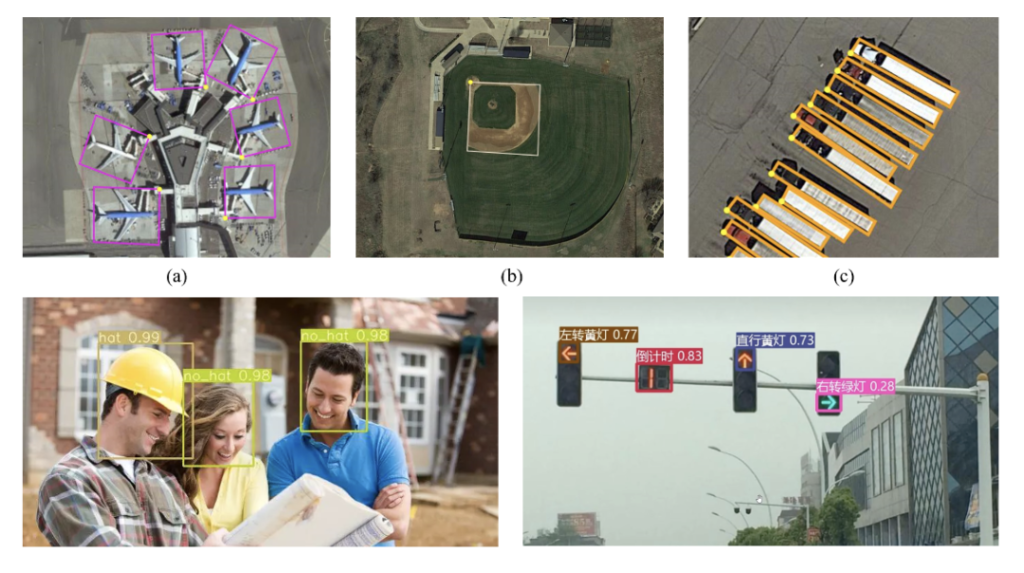

CNN算法迅速引起了當時業內的關注。在2012年,基于這個算法,誕生了圖像識別的諸多應用,如人臉識別、物體識別、圖像分類等。像我們熟悉的AI四小龍也是在這個時間段誕生。

在行業的共同推進下,圖像識別技術迅速在包括支付、營銷、安防、自動駕駛、工業質檢、智慧城市等領域迅速發展,很多領域開始深入應用圖像識別技術,如今這個技術已經深入到了我們的工作和生活中。

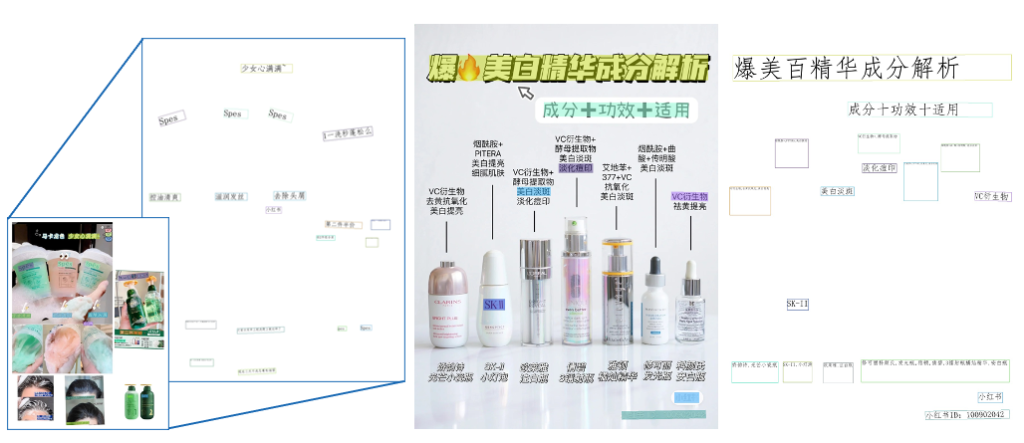

在營銷領域,分析用戶喜好可以更加直觀,除了文字識別,還可以加入對于評測的圖像識別,讓品牌對于社媒評測的理解更加立體。

02 乘風破浪:生成式對抗網絡GAN

算法介紹

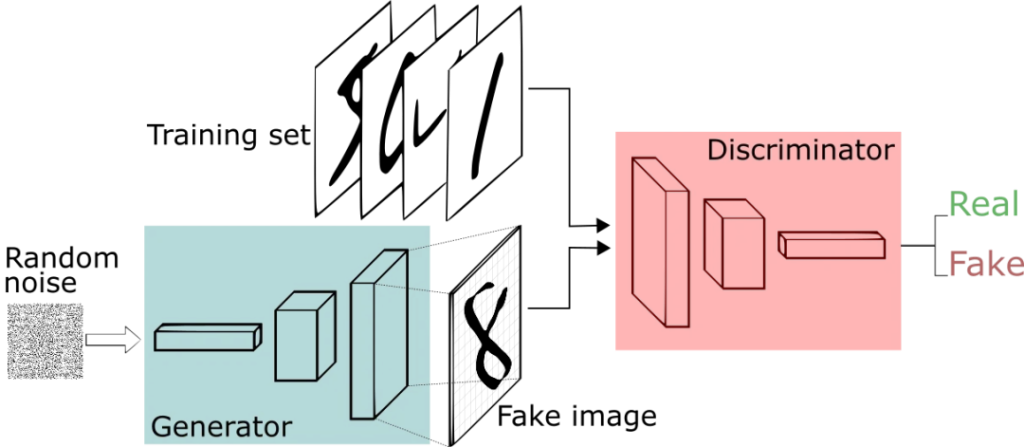

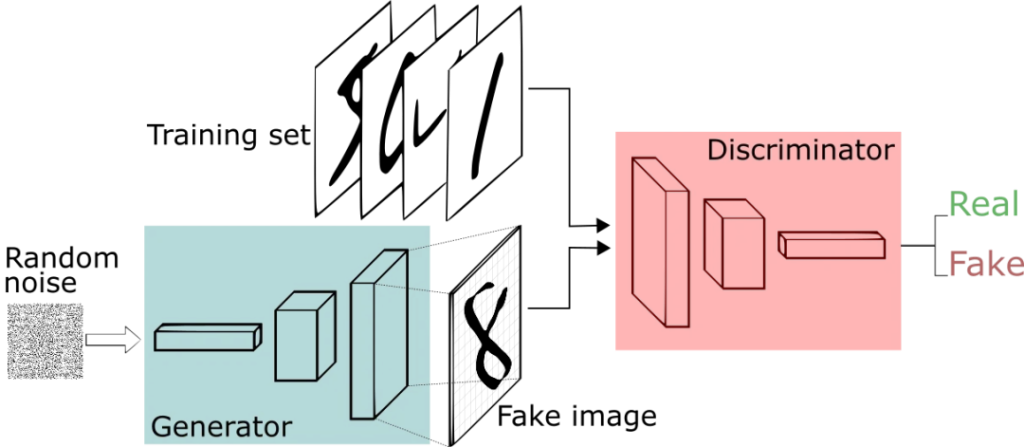

時間來到2014年10月,“GAN之父”Ian Goodfellow提出了生成式對抗網絡,廣泛使用于圖像生成、數據增強和文本生成等任務。顧名思義,這個深度學習模型由兩個神經網絡組成,分別是生成器和判別器,并讓他們相互“對抗”。生成器用于生成新的樣本,而判別器則用于判斷生成器生成的樣本是否真實。兩個模型互相博弈,在虛擬與求真的對抗中,逐步訓練并生成一個更佳的內容。

GAN的算法模型可謂“家族龐大”,在2014年之后,沿著這種“對抗”的思路,生成對抗模型也一直在發展,包括Pix2Pix、SRGAN、Cycle-GAN、BigGAN、StyleGAN……等。

算法應用

伴隨著GAN模型體系的發展,圖片的生成也從圖片到圖片的風格遷移,發展到了文本指導的圖片生成,可以實現圖片風格、人臉特征、物體細節的轉變。

這個階段,我們能夠看到的營銷玩法就更加多樣化了,在圖片美化、視頻拍攝和剪輯、視頻特效、視頻會議等等方面,都有了很多使用場景。

?03 繼往開來:Vision Transfomer模型

算法介紹

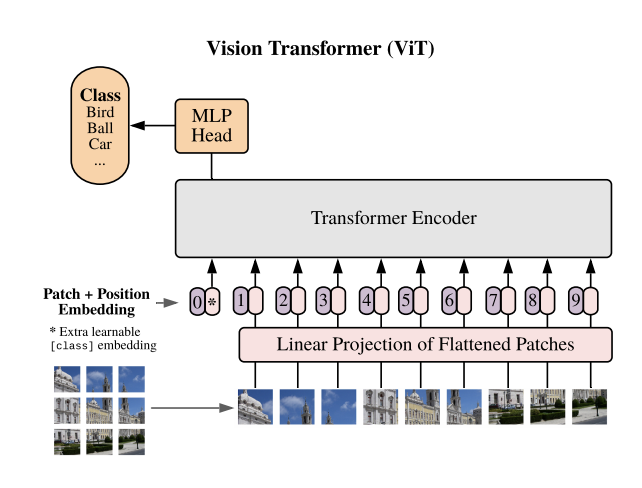

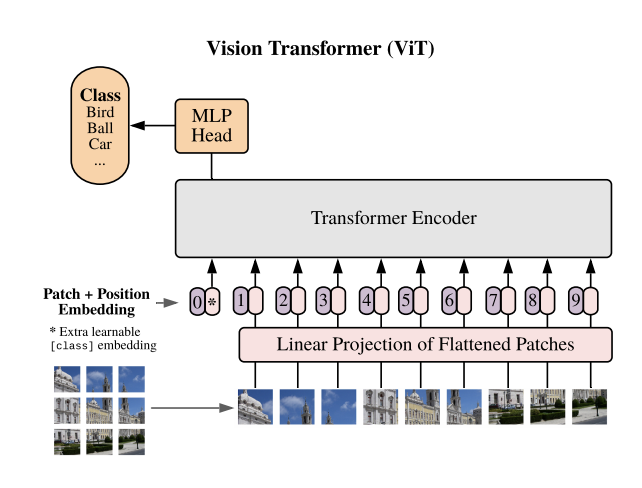

2020年,Vision Transformers模型(ViT模型)把NLP領域霸榜的模型引入了視覺領域。相比傳統的卷積神經網絡(CNN)模型,Vision Transformers將圖像劃分為多個小塊(patches),并引入自注意力機制,通過學習更大規模的數據集,實現了規模和計算精度的一個跨越式的提升。

算法應用

一方面,ViT模型可以在很多領域實現顯著的精度提升,包括圖像分類、目標檢測、對象檢索、語義分割、圖像生成和視頻摘要等多個領域。

另一方面,ViT模型將視覺能力引入到自然語言理解模型范式中,顯著降低了不同模態(如視覺和文本)信息的交互成本,充分激發了多模態領域的蓬勃發展,這也為后續的大模型做了充分的準備。

04 精益求精:擴散模型Diffusion

算法介紹

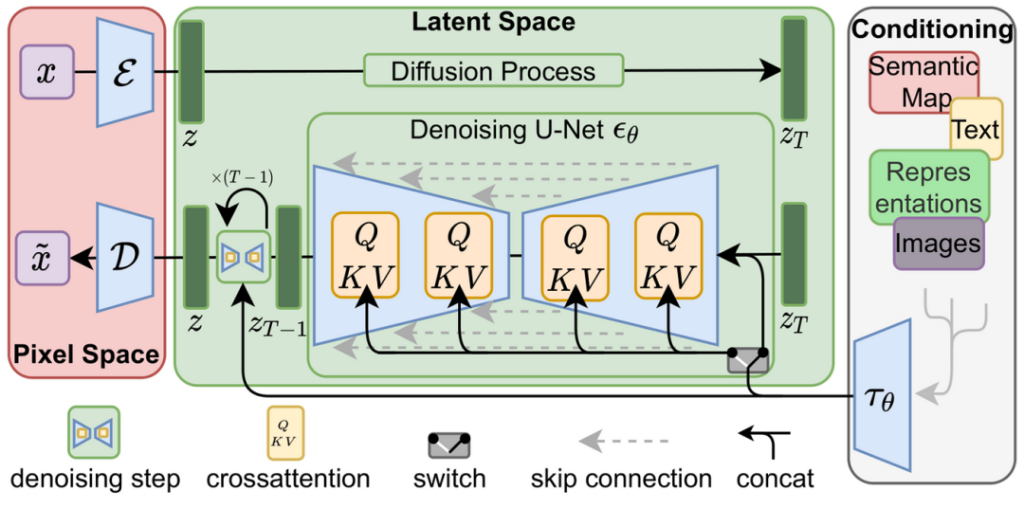

之所以我們看到Midjourney等生成式AI系統在畫圖領域這么火,主要是因為2022年,Diffusion模型的“進化“。

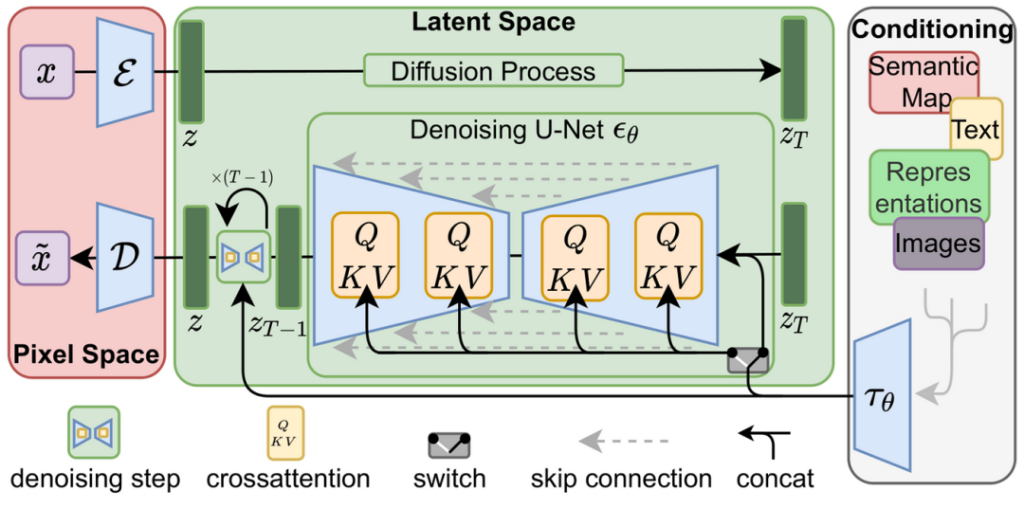

作為一種機器學習技術,Generative Diffusion Models(生成式擴散模型)具有強大的生成能力。它們能夠根據給定的初始值和一些參數,在訓練過程中逐步演化生成新的數據樣本。其核心思想是通過迭代的擴散過程來生成數據:從一個初始值開始,并通過多個迭代步驟逐漸“擴散”數據。每個迭代步驟都會降低這些隨機噪聲,并根據模型的參數和其他約束條件(如文本、圖片等)進行數據更新。隨著迭代的進行,數據逐漸演化,生成出與訓練數據類似的新樣本。通過使用Generative Diffusion Models,我們可以生成逼真的圖像、音頻、文本等多種類型的數據。

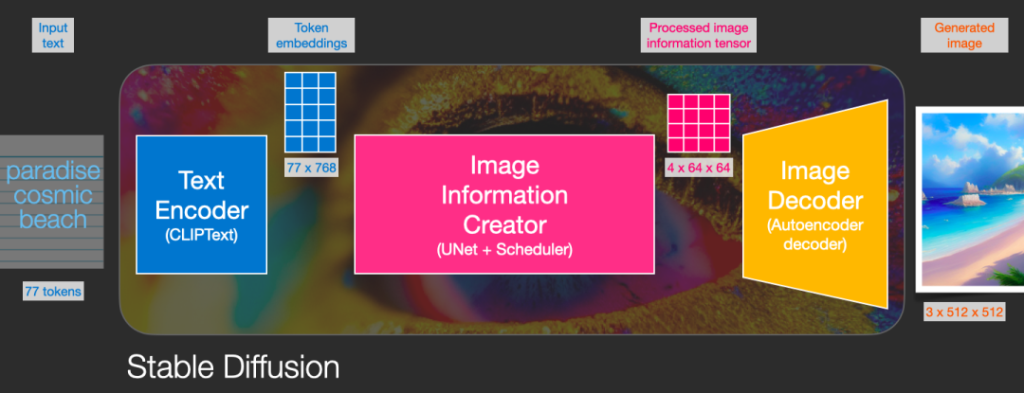

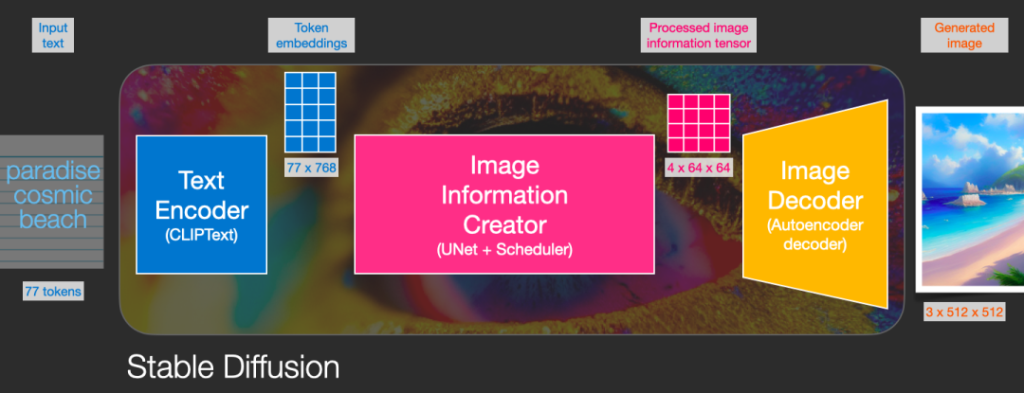

在2022年7月,創業公司提出Stable Diffusion并開源使用,進一步推進了AIGC在視覺任務的發展。該算法使用了感知壓縮(Perceptual Compression)的技巧,將圖像從像素空間映射到潛在空間,然后在潛在空間上進行擴散操作,最后再解碼回像素空間。它還引入了條件機制(Conditioning Mechanisms),通過交叉注意力(Cross-Attention)的方式來實現多模態訓練,使得條件圖片生成任務也可以實現。這一模型大幅降低了訓練成本,提升了收斂速度與訓練穩定性,一經發布迅速地成為了AIGC中的基線模型,研究者和創業者們基于這一算法思想,孕育了更多的算法與應用創新。

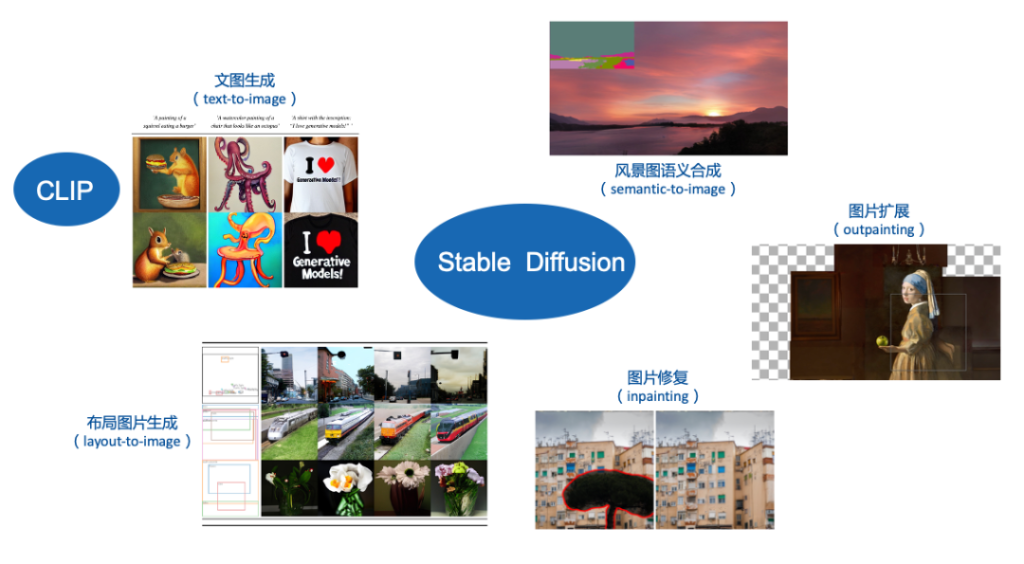

算法應用

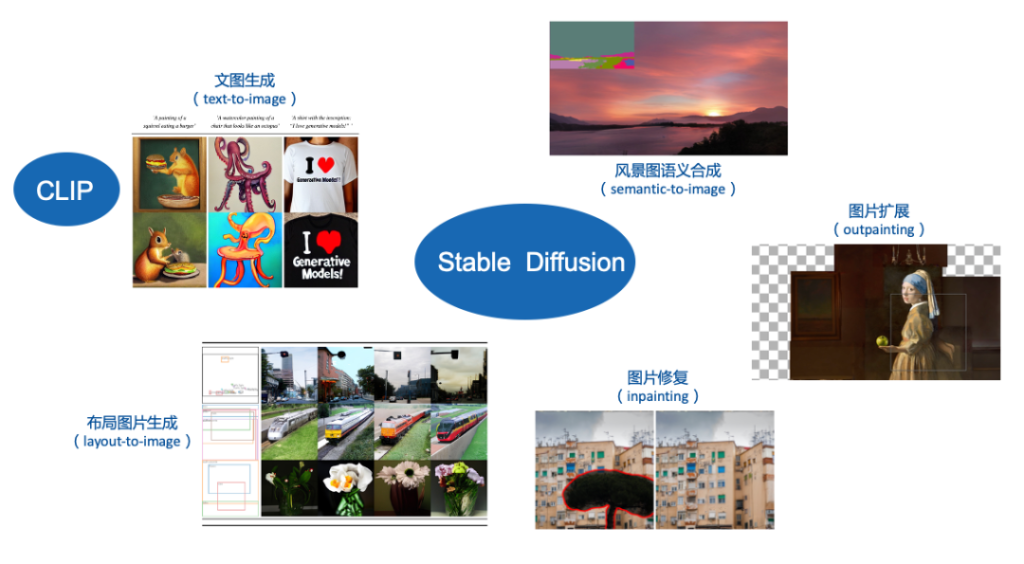

通過Diffusion Models, 我們看到了更多視覺生成的可能性,除了文圖生成,還有類似風景圖語義合成、布局圖片生成、圖片修復、圖片擴展等等。在語義和圖像的結合上,機器能做到更深入的理解和輸出了。

這一部分在營銷應用上有巨大潛力。例如,利用LORA技術,我們可以使用17張不同角度的車輛圖片訓練模型,并根據需求將訓練的車型與任意背景進行融合。這樣,我們可以在3-5分鐘內生成出右側展示的圖片,該車型能夠完美融入歐式街道背景,實現出色效果。

其實,我們可以看到很多人開始探索這項技術在多種任務上的應用,比如漫畫插圖、AI技術模特、室內設計出渲染方案。可以說,我們已經在方方面面感受到了生成式AI在視覺與營銷的結合上可以有非常多的想象空間。

05 未來已來:多模態模型正在發展

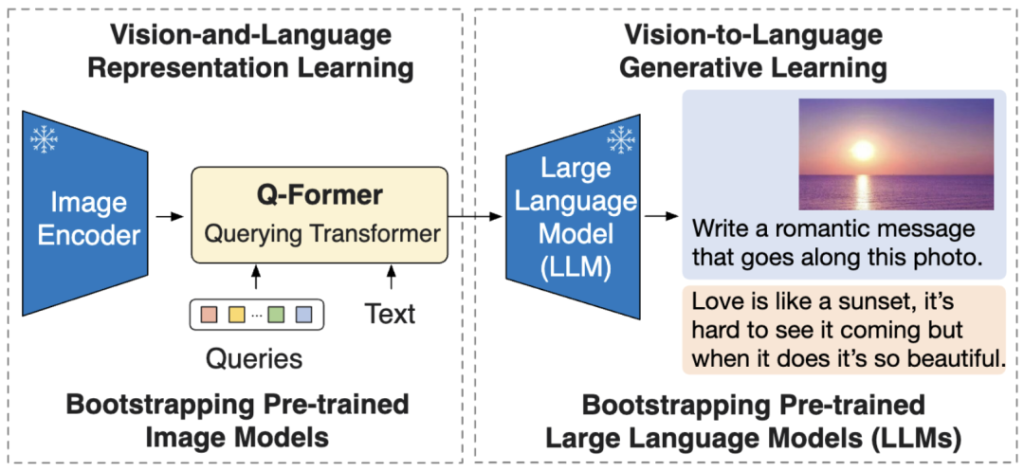

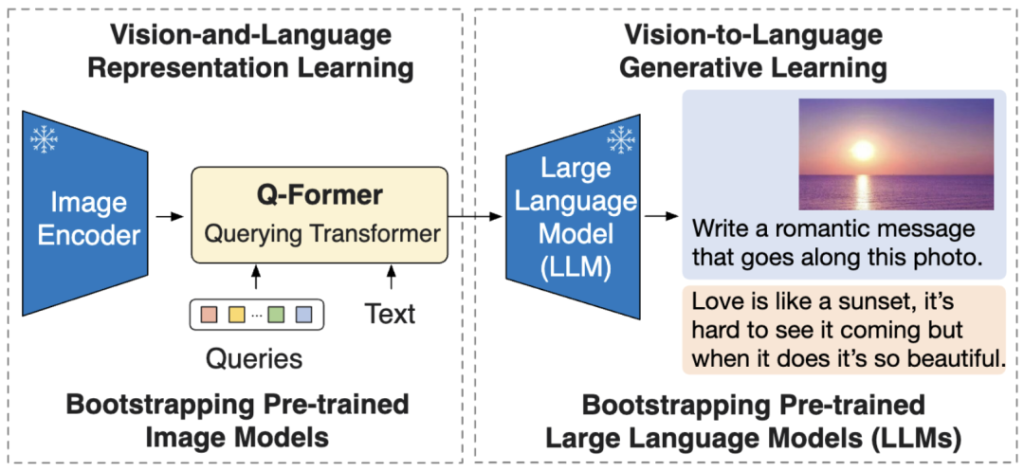

大型模型的迭代速度非常快,最近我們觀察到熱門的研究方向還集中在多模態訓練上。在ChatGPT大火的今天,大語言模型已經被人們所熟知,但既包括自然語言輸入、又包括圖像輸入的網絡結構,也引起了研究者們的關注。在下圖中,圖片編碼器處理輸入圖像,提取其高維特征,并通過Q-Former這樣一個Transformer結構,架設了視覺與大型語言模型的橋梁。

舉個例子,我們輸入一張圖片,并要求網絡根據該圖像描述一段浪漫的文字,輸出結果可能是”愛就像落日,雖然它很難被察覺,但一旦出現,它是如此美麗”。這樣的句子即清晰地描述了圖片的內容,又延伸出了一種浪漫的感覺。這種融合了圖像和語言信息的模型似乎真的能讓我們感受到機器的浪漫。在營銷智能里,我們期盼這樣的多模態大模型能給業務帶來更多有想象力的應用。

營銷新時代

未來我們面臨的是新范式下的新時代,相信,也是創意與營銷生產力爆發的時代。隨著機器告訴我們浪漫的落日與愛,我們似乎可以真的可以和“機器模型”一起,去探索消費者的心智,分析真正的消費趨勢和需求熱點。而通過生成式AI的賦能,我們也可以更好的提供個性化的用戶體驗,讓營銷人從重復勞動中解放出來,和AI共同探討創意本身。期待AI和我們并肩,實現真正的人機同行。

以客戶為中心,集新模式與高質量服務為一體

以客戶為中心,集新模式與高質量服務為一體 助力零售行業打造覆蓋客戶全生命周期的數值化運營體系

助力零售行業打造覆蓋客戶全生命周期的數值化運營體系 圍繞家具行業消費者連接的全流程, 從引流獲客,導購,設計賦能

圍繞家具行業消費者連接的全流程, 從引流獲客,導購,設計賦能 從品牌商家的核心訴求出發,重新定 義“人貨物,構建以大數據驅動的….

從品牌商家的核心訴求出發,重新定 義“人貨物,構建以大數據驅動的…. 幫助家電3C企業構建公域私域聯動的 流量

幫助家電3C企業構建公域私域聯動的 流量 母嬰消費者數據全鏈路管理,發現消費者全鏈路路徑路徑決策點,沉淀母嬰行業全鏈路消費數據

母嬰消費者數據全鏈路管理,發現消費者全鏈路路徑路徑決策點,沉淀母嬰行業全鏈路消費數據